Gadgets

Quand une lumière est un voleur qui ordonne à votre porte de garage de s'ouvrir

Crédit: lightcommands.com

Des lasers brillants chez des assistants vocaux tels qu'Alexa et Siri, des chercheurs du Michigan et du Japon ont réussi un piratage dans lequel les lasers avaient le pouvoir de commander la voix humaine.

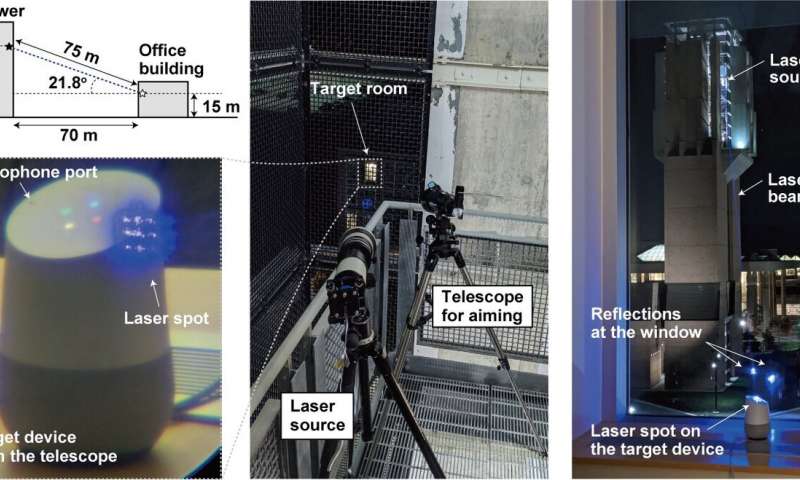

En plaçant le laser à travers la fenêtre des microphones à l'intérieur de périphériques tels que des tablettes ou des téléphones, un attaquant lointain peut envoyer à distance des commandes inaudibles et potentiellement invisibles exécutées par Alexa, Portal, Google assistant ou Siri.

En termes simples, un attaquant peut pirater l'assistant vocal et envoyer des commandes.

Comment l'équipe a-t-elle réalisé la lumière en tant que son? Une vulnérabilité dans les microphones utilisant des systèmes micro-électro-mécaniques (MEMS) est exploitée. Les composants MEMS réagissent involontairement à la lumière comme si elle était saine, a déclaré Ars Technica.

Quel est le pire qui puisse arriver? Beaucoup. Ars Technica a décrit les lasers injectant des commandes inaudibles dans les dispositifs et les forçant subrepticement à «déverrouiller les portes, visiter des sites Web et localiser, déverrouiller et démarrer des véhicules».

Les chercheurs ont discuté de leurs travaux dans leur article publié lundi. "Commandes légères: attaques par injection audio au laser sur des systèmes contrôlés par la voix", écrit par cinq auteurs affiliés à l’Université du Michigan (quatre) et à l’Université des électro-communications du Japon (un).

"Dans notre document", ont-ils déclaré, "nous démontrons cet effet, en utilisant avec succès la lumière pour injecter des commandes malveillantes dans plusieurs dispositifs contrôlés par la voix tels que des haut-parleurs intelligents, des tablettes et des téléphones sur de grandes distances et à travers des fenêtres en verre".

A-t-il été facile à réaliser?

Pour contrecarrer l'authentification, assez facile.

"Les systèmes à commande vocale ne nécessitent souvent pas que les utilisateurs s’authentifient eux-mêmes", écrit-il. Ars TechnicaC'est Dan Goodin. L'attaque dans ces cas pourrait être fréquemment effectuée sans avoir besoin de mots de passe ou de codes confidentiels. Fréquemment. "Même lorsque les systèmes requièrent une authentification pour certaines actions", at-il ajouté, "il peut être faisable de forcer brutalement le code PIN, car de nombreux appareils ne limitent pas le nombre de suppositions qu'un utilisateur peut faire".

En outre, l'attaque n'était pas chère à mener. Les commandes de lumière peuvent être montées à moindre coût, a déclaré un présentateur vidéo, en utilisant des pointeurs laser classiques. Cela pourrait même être fait entre deux bâtiments.

L’équipe a déclaré avoir tenté d’attaquer les systèmes de reconnaissance vocale les plus répandus, à savoir Amazon Alexa, Apple Siri, le portail Facebook et Google Assistant. En réalité, "tout système utilisant des microphones MEMS et exploitant ces données sans confirmation supplémentaire de l'utilisateur peut être vulnérable", selon leur propre site de commandes de lumière.

Quel est le danger avec Light Commands?

Alexa, quel temps fait-il? C'est inoffensif. L'attaquant peut contrôler les commutateurs Smart-Home. Ouvrez les portes de garage intelligentes. Démarrez les véhicules à distance. En fait, vous pouvez regarder une vidéo injectant "OK Google, ouvrez la porte du garage" à une maison Google, simplement en faisant briller un pointeur laser bon marché.

Que peut-on faire pour se protéger contre la vulnérabilité? Le présentateur vidéo a déclaré que la vulnérabilité de base ne pouvait pas être résolue sans une nouvelle conception coûteuse du microphone.

"Nous collaborons avec Amazon, Google, Apple et d'autres fournisseurs sur des mesures défensives." Ils ont plus d'informations et de démonstrations à lightcommands.com.

"Une couche d'authentification supplémentaire peut être efficace pour atténuer quelque peu l'attaque. Sinon, au cas où l'attaquant ne pourrait pas écouter la réponse du périphérique, le fait de demander à l'utilisateur une simple question aléatoire avant que l'exécution de la commande ne soit un moyen efficace de le prévenir. d'obtenir une exécution réussie de la commande.

"Les fabricants peuvent également essayer d'utiliser des techniques de fusion de capteurs, telles que l'acquisition de l'audio de plusieurs microphones. Lorsque l'attaquant utilise un seul laser, un seul microphone reçoit un signal alors que les autres ne reçoivent rien …

Une autre approche consiste à réduire la quantité de lumière atteignant le diaphragme du microphone en utilisant une barrière qui bloque physiquement les faisceaux lumineux droits afin d'éliminer la ligne de visée du diaphragme, ou de mettre en place un cache non transparent sur le trou du microphone pour atténuer la quantité de lumière visible. la lumière frappe le microphone. Cependant, nous notons que de telles barrières physiques ne sont efficaces qu’à un certain point, puisqu’un attaquant peut toujours augmenter la puissance du laser pour tenter de compenser l’atténuation induite par la couverture ou pour brûler les barrières, créant ainsi un nouveau faisceau lumineux. "

Ce qui précède est apparu sur leur site de commandes de lumière, tandis que le document discute également des approches et des limitations en matière d'atténuation.

Pendant ce temps, Mariella Moon dans Engadget a rappelé à ses lecteurs que ce ne serait pas la première fois que des chercheurs découvraient des vulnérabilités dans les assistants numériques. "Des chercheurs de l'Université chinoise de Zheijiang ont découvert que Siri, Alexa et d'autres assistants vocaux peuvent être manipulés avec des commandes envoyées à des fréquences ultrasonores."

Alexa, l'assistante numérique d'Amazon, vous plonge dans la tête

lightcommands.com/

Papier (PDF): lightcommands.com/20191104-Light-Commands.pdf

© 2019 Science X Network

Citation:

Quand une lumière est un voleur qui ordonne à la porte de votre garage de s'ouvrir (6 novembre 2019)

récupéré le 7 novembre 2019

à partir de https://techxplore.com/news/2019-11-thief-garage-door.html

Ce document est soumis au droit d'auteur. Mis à part toute utilisation équitable à des fins d’étude ou de recherche privée, aucun

partie peut être reproduite sans autorisation écrite. Le contenu est fourni seulement pour information.

Sommaire