Internet

Un système d’intelligence artificielle pourrait aider à contrer la propagation de la désinformation

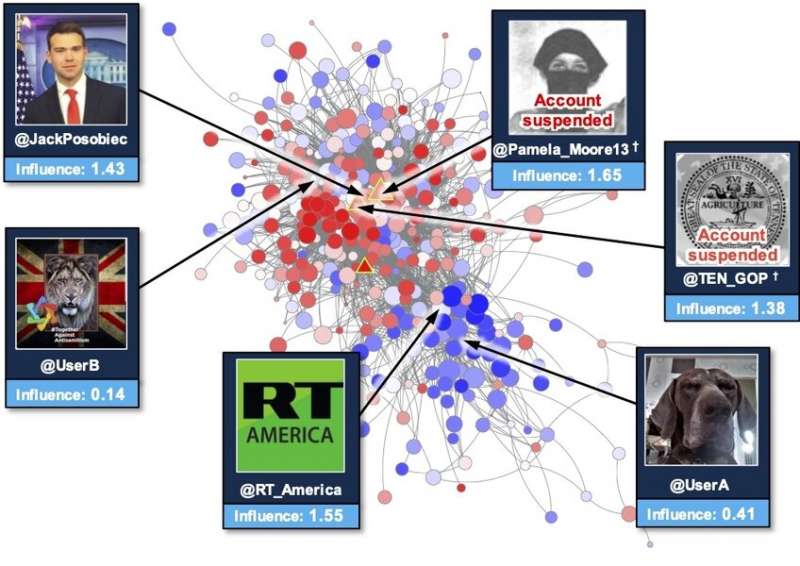

L’équipe de recherche Reconnaissance of Influence Operations du Lincoln Laboratory a cartographié un réseau de propagande Twitter étranger qui était actif lors de l’élection présidentielle française de 2017. Les cercles rouges plus grands représentent les comptes d’opérations influents et susceptibles d’influencer. Crédit: Massachusetts Institute of Technology

Les campagnes de désinformation ne sont pas nouvelles – pensez à la propagande de guerre utilisée pour influencer l’opinion publique contre un ennemi. Ce qui est nouveau, cependant, c’est l’utilisation d’Internet et des médias sociaux pour diffuser ces campagnes. La propagation de la désinformation via les médias sociaux a le pouvoir de changer les élections, de renforcer les théories du complot et de semer la discorde.

Steven Smith, membre du personnel du groupe Architectures et algorithmes de logiciels d’intelligence artificielle du MIT Lincoln Laboratory, fait partie d’une équipe qui a entrepris de mieux comprendre ces campagnes en lançant le programme Reconnaissance of Influence Operations (RIO). Leur objectif était de créer un système qui détecterait automatiquement les récits de désinformation ainsi que les individus qui diffusent les récits sur les réseaux sociaux. Plus tôt cette année, l’équipe a publié un article sur son travail dans le Actes de l’Académie nationale des sciences et ils ont reçu un prix R&D 100 l’automne dernier.

Le projet a vu le jour en 2014 lorsque Smith et ses collègues étudiaient comment des groupes malveillants pouvaient exploiter les médias sociaux. Ils ont remarqué une activité accrue et inhabituelle dans les données des médias sociaux à partir de comptes qui avaient l’apparence de pousser des récits pro-russes.

«Nous nous grattions la tête en quelque sorte», dit Smith à propos des données. L’équipe a donc sollicité un financement interne via le bureau technologique du laboratoire et lancé le programme afin d’étudier si des techniques similaires seraient utilisées lors des élections françaises de 2017.

Dans les 30 jours qui ont précédé les élections, l’équipe de RIO a collecté des données en temps réel sur les réseaux sociaux pour rechercher et analyser la propagation de la désinformation. Au total, ils ont compilé 28 millions de publications Twitter à partir d’un million de comptes. Ensuite, en utilisant le système RIO, ils ont pu détecter les comptes de désinformation avec une précision de 96%.

Ce qui rend le système RIO unique, c’est qu’il combine plusieurs techniques d’analyse afin de créer une vue complète de l’endroit et de la manière dont les récits de désinformation se propagent.

«Si vous essayez de répondre à la question de savoir qui est influent sur un réseau social, traditionnellement, les gens regardent le nombre d’activités», explique Edward Kao, qui est un autre membre de l’équipe de recherche. Sur Twitter, par exemple, les analystes prendraient en compte le nombre de tweets et de retweets. « Ce que nous avons constaté, c’est que dans de nombreux cas, ce n’est pas suffisant. Cela ne vous dit pas réellement l’impact des comptes sur le réseau social. »

Dans le cadre du doctorat de Kao. Travaillant dans le cadre du programme Lincoln Scholars du laboratoire, un programme de bourses de scolarité, il a développé une approche statistique – maintenant utilisée à RIO – pour aider à déterminer non seulement si un compte de réseau social diffuse de la désinformation, mais aussi dans quelle mesure le compte amène le réseau dans son ensemble à changer et amplifier le message.

Erika Mackin, une autre membre de l’équipe de recherche, a également appliqué une nouvelle approche d’apprentissage automatique qui aide RIO à classer ces comptes en examinant les données liées aux comportements tels que si le compte interagit avec des médias étrangers et quelles langues il utilise. Cette approche permet à RIO de détecter les comptes hostiles qui sont actifs dans diverses campagnes, allant des élections présidentielles françaises de 2017 à la propagation de la désinformation COVID-19.

Un autre aspect unique de RIO est qu’il peut détecter et quantifier l’impact des comptes gérés à la fois par des robots et des humains, alors que la plupart des systèmes automatisés utilisés aujourd’hui ne détectent que les robots. RIO a également la capacité d’aider ceux qui utilisent le système à prévoir comment différentes contre-mesures pourraient arrêter la propagation d’une campagne de désinformation particulière.

L’équipe envisage l’utilisation de RIO par le gouvernement et l’industrie, ainsi qu’au-delà des médias sociaux et dans le domaine des médias traditionnels tels que les journaux et la télévision. Actuellement, ils travaillent avec Joseph Schlessinger, étudiant de West Point, également étudiant diplômé du MIT et membre militaire du Lincoln Laboratory, pour comprendre comment les récits se propagent dans les médias européens. Un nouveau programme de suivi est également en cours pour se plonger dans les aspects cognitifs des opérations d’influence et comment les attitudes et les comportements individuels sont affectés par la désinformation.

«Se défendre contre la désinformation n’est pas seulement une question de sécurité nationale, mais aussi de protéger la démocratie», dit Kao.

L’UE renforce son code de désinformation pour éviter les profits publicitaires numériques

Steven T.Smith et al, Détection automatique des acteurs influents dans les réseaux de désinformation, Actes de l’Académie nationale des sciences (2021). DOI: 10.1073 / pnas.2011216118

Fourni par le Massachusetts Institute of Technology

Cette histoire est republiée avec l’aimable autorisation de MIT News (web.mit.edu/newsoffice/), un site populaire qui couvre l’actualité de la recherche, de l’innovation et de l’enseignement du MIT.

Citation: Un système d’intelligence artificielle pourrait aider à contrer la propagation de la désinformation (2021, 28 mai) récupéré le 28 mai 2021 sur https://techxplore.com/news/2021-05-artificial-intelligence-counter-disinformation.html

Ce document est soumis au droit d’auteur. En dehors de toute utilisation équitable à des fins d’étude ou de recherche privée, aucune partie ne peut être reproduite sans l’autorisation écrite. Le contenu est fourni seulement pour information.

Sommaire