Internet

Filtrer les robots sociaux peut aider les équipes d'intervention critiques à voir ce qui se passe en temps réel

Crédit: Mehwish Nasim

Les chercheurs ont créé un algorithme permettant de faire la distinction entre la désinformation et les conversations authentiques sur Twitter, en détectant les messages envoyés par des robots sociaux.

Mehwish Nasim et ses collègues de la Faculté des sciences mathématiques de l'Université d'Adélaïde affirment que cet algorithme facilitera la détection des événements majeurs par les services d'urgence, tels que troubles civils, catastrophes naturelles et épidémies de grippe.

"Quand quelque chose de vraiment important se passe, les gens tweetent une énorme quantité d'informations utiles", déclare Mehwish.

"Le fait de pouvoir filtrer rapidement les intrants polluants des robots sociaux, qui génèrent de multiples messages qui faussent le flux d'informations humaines, aidera les services répressifs, les équipes de réponse aux incidents et les volontaires à agir rapidement".

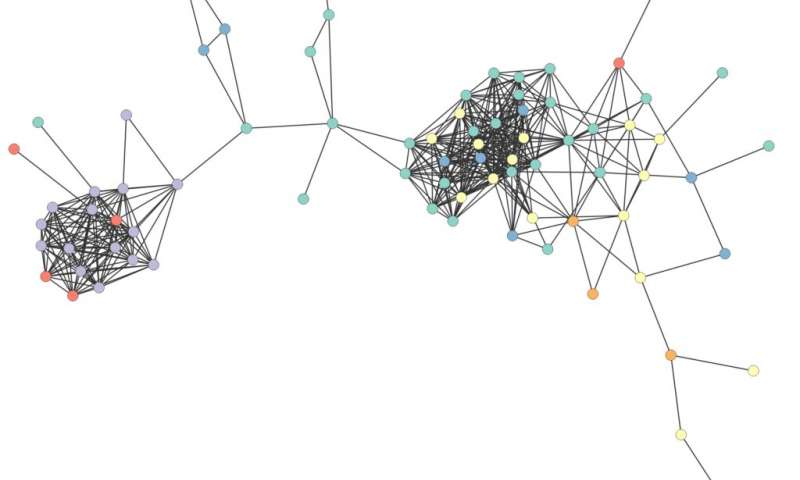

L'algorithme fonctionne en calculant la diversité dans les tweets et la coordination temporelle.

Les comptes de bot ont des tweets moins divers. Par exemple, ils utilisent à plusieurs reprises les mêmes URL ou hashtags et tweetent à peu près au même moment.

Mehwish, qui travaille maintenant au CSIRO's Data61, la branche spécialisée dans les données et le numérique de l'agence scientifique nationale australienne, a déclaré qu'en filtrant les fausses informations automatisées, les agences pourront facilement accéder aux informations de première main par les personnes sur le terrain lors de grands événements. .

"Par exemple", ajoute-t-elle, "des tweets de minute en minute au cours des récentes urgences en NSF et dans le Queensland pourraient être extrêmement utiles pour orienter les interventions spécifiques des services d'incendie."

Comment truquer une élection: le problème de Twitter avec les saboteurs politiques

Mehwish Nasim et al. Détection en temps réel des pollueurs contenus dans les réseaux Twitter partiellement observables, Compagnon de la Conférence Web 2018 sur la Conférence Web 2018 – WWW '18 (2018). DOI: 10.1145 / 3184558.3191574

Jonathan Tuke et al. Prédiction Pachinko: une méthode bayésienne de prévision d’événement à partir de données de médias sociaux, Traitement et gestion de l'information (2019). DOI: 10.1016 / j.ipm.2019.102147

Fourni par

Freshscience

Citation:

Filtrer les robots sociaux peut aider les équipes d'intervention critiques à voir ce qui se passe en temps réel (5 décembre 2019)

récupéré le 5 décembre 2019

sur https://techxplore.com/news/2019-12-filtering-social-bots-critical-response.html

Ce document est soumis au droit d'auteur. Mis à part toute utilisation équitable à des fins d’étude ou de recherche privée, aucun

partie peut être reproduite sans autorisation écrite. Le contenu est fourni seulement pour information.

Sommaire