Internet

Le lanceur d’alerte de Facebook dit que les algorithmes de l’entreprise sont dangereux – voici comment ils peuvent vous manipuler

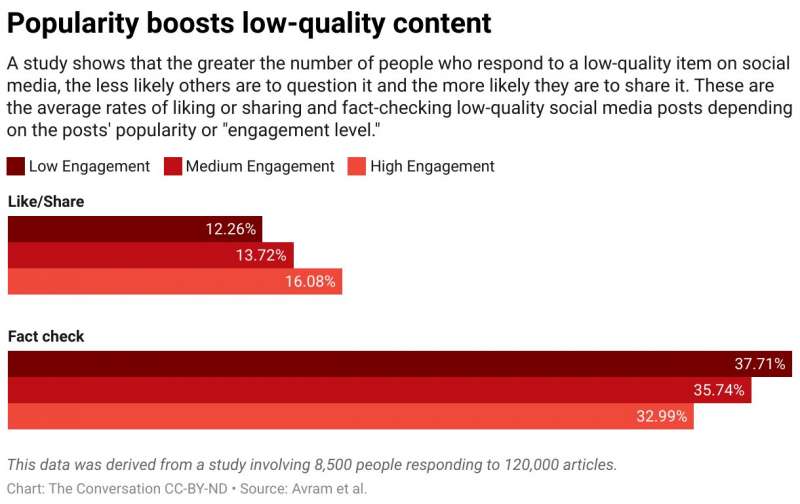

Ces données sont issues d’une étude portant sur 8 500 personnes ayant répondu à 120 000 articles. Crédit : Graphique : La conversation CC-BY-ND Source : Avram et al.

L’ancienne chef de produit Facebook, Frances Haugen, a déclaré devant le Sénat américain le 5 octobre 2021 que les plateformes de médias sociaux de l’entreprise « nuisaient aux enfants, attisent la division et affaiblissent notre démocratie ».

Haugen était la principale source d’un article du Wall Street Journal sur l’entreprise. Elle a qualifié les algorithmes de Facebook de dangereux, a déclaré que les dirigeants de Facebook étaient conscients de la menace mais faisaient passer les bénéfices avant les gens, et a appelé le Congrès à réglementer l’entreprise.

Les plateformes de médias sociaux s’appuient fortement sur le comportement des gens pour décider du contenu que vous voyez. En particulier, ils surveillent le contenu auquel les gens réagissent ou « interagissent » en appréciant, en commentant et en partageant. Les fermes de trolls, les organisations qui diffusent du contenu provocateur, exploitent cela en copiant le contenu à fort engagement et en le publiant comme le leur, ce qui les aide à toucher un large public.

En tant qu’informaticien qui étudie la manière dont un grand nombre de personnes interagissent à l’aide de la technologie, je comprends la logique d’utiliser la sagesse des foules dans ces algorithmes. Je vois également des pièges importants dans la façon dont les sociétés de médias sociaux le font dans la pratique.

Des lions de la savane aux likes sur Facebook

Le concept de la sagesse des foules suppose que l’utilisation des signaux des actions, des opinions et des préférences des autres comme guide conduira à des décisions judicieuses. Par exemple, les prédictions collectives sont normalement plus précises que les prédictions individuelles. L’intelligence collective est utilisée pour prédire les marchés financiers, les sports, les élections et même les épidémies.

Au cours de millions d’années d’évolution, ces principes ont été codés dans le cerveau humain sous la forme de biais cognitifs portant des noms tels que familiarité, simple exposition et effet d’entraînement. Si tout le monde se met à courir, vous devriez également commencer à courir ; peut-être que quelqu’un a vu un lion venir et courir pourrait vous sauver la vie. Vous ne savez peut-être pas pourquoi, mais il est plus sage de poser des questions plus tard.

Votre cerveau capte des indices de l’environnement, y compris de vos pairs, et utilise des règles simples pour traduire rapidement ces signaux en décisions : suivez le gagnant, suivez la majorité, copiez votre voisin. Ces règles fonctionnent remarquablement bien dans des situations typiques car elles sont basées sur des hypothèses solides. Par exemple, ils supposent que les gens agissent souvent de manière rationnelle, il est peu probable que beaucoup se trompent, le passé prédit l’avenir, etc.

La technologie permet aux gens d’accéder aux signaux d’un plus grand nombre d’autres personnes, dont la plupart ne connaissent pas. Les applications d’intelligence artificielle font un usage intensif de ces signaux de popularité ou d’« engagement », de la sélection des résultats des moteurs de recherche à la recommandation de musique et de vidéos, et de la suggestion d’amis au classement des publications sur les fils d’actualité.

Tout ce qui est viral ne mérite pas d’être

Notre recherche montre que pratiquement toutes les plateformes technologiques Web, telles que les médias sociaux et les systèmes de recommandation d’actualités, ont un fort biais de popularité. Lorsque les applications sont motivées par des indices tels que l’engagement plutôt que par des requêtes explicites des moteurs de recherche, le biais de popularité peut entraîner des conséquences imprévues néfastes.

Les médias sociaux comme Facebook, Instagram, Twitter, YouTube et TikTok s’appuient fortement sur des algorithmes d’IA pour classer et recommander du contenu. Ces algorithmes prennent en entrée ce que vous aimez, commentez et partagez, en d’autres termes, le contenu avec lequel vous interagissez. L’objectif des algorithmes est de maximiser l’engagement en découvrant ce que les gens aiment et en le classant en haut de leurs flux.

En surface, cela semble raisonnable. Si les gens aiment les nouvelles crédibles, les opinions d’experts et les vidéos amusantes, ces algorithmes devraient identifier un contenu de cette qualité. Mais la sagesse des foules fait ici une hypothèse clé : que recommander ce qui est populaire aidera un contenu de haute qualité à « bouillonner ».

Nous avons testé cette hypothèse en étudiant un algorithme qui classe les éléments en utilisant un mélange de qualité et de popularité. Nous avons constaté qu’en général, le biais de popularité est plus susceptible de réduire la qualité globale du contenu. La raison en est que l’engagement n’est pas un indicateur fiable de qualité lorsque peu de personnes ont été exposées à un élément. Dans ces cas, l’engagement génère un signal bruité, et l’algorithme est susceptible d’amplifier ce bruit initial. Une fois que la popularité d’un article de mauvaise qualité est suffisamment grande, elle continuera à s’amplifier.

Les algorithmes ne sont pas la seule chose affectée par le biais d’engagement, ils peuvent également affecter les gens. Les preuves montrent que les informations sont transmises par « contagion complexe », ce qui signifie que plus les gens sont exposés à une idée en ligne, plus ils sont susceptibles de l’adopter et de la partager. Lorsque les médias sociaux disent aux gens qu’un élément devient viral, leurs biais cognitifs se manifestent et se traduisent par l’envie irrésistible d’y prêter attention et de le partager.

Des foules pas si sages

Nous avons récemment mené une expérience à l’aide d’une application d’alphabétisation appelée Fakey. C’est un jeu développé par notre laboratoire qui simule un fil d’actualité comme ceux de Facebook et Twitter. Les joueurs voient un mélange d’articles actuels provenant de fausses nouvelles, de la science indésirable, de sources hyperpartisanes et complotistes, ainsi que de sources grand public. Ils obtiennent des points pour partager ou aimer des informations provenant de sources fiables et pour signaler des articles peu crédibles à des fins de vérification des faits.

Nous avons constaté que les joueurs sont plus susceptibles d’aimer ou de partager et moins susceptibles de signaler des articles provenant de sources peu crédibles lorsque les joueurs peuvent voir que de nombreux autres utilisateurs ont interagi avec ces articles. L’exposition aux métriques d’engagement crée donc une vulnérabilité.

La sagesse des foules échoue parce qu’elle est fondée sur la fausse hypothèse que la foule est composée de sources diverses et indépendantes. Il peut y avoir plusieurs raisons pour lesquelles ce n’est pas le cas.

Premièrement, en raison de la tendance des gens à s’associer avec des personnes similaires, leurs quartiers en ligne ne sont pas très diversifiés. La facilité avec laquelle les utilisateurs de médias sociaux peuvent se débarrasser de ceux avec qui ils ne sont pas d’accord pousse les gens dans des communautés homogènes, souvent appelées chambres d’écho.

Deuxièmement, parce que les amis de nombreuses personnes sont amis les uns des autres, ils s’influencent les uns les autres. Une expérience célèbre a démontré que savoir quelle musique vos amis aiment affecte vos propres préférences déclarées. Votre désir social de vous conformer fausse votre jugement indépendant.

Troisièmement, les signaux de popularité peuvent être joués. Au fil des ans, les moteurs de recherche ont développé des techniques sophistiquées pour contrer les « fermes de liens » et d’autres schémas visant à manipuler les algorithmes de recherche. Les plateformes de médias sociaux, en revanche, commencent tout juste à découvrir leurs propres vulnérabilités.

Les personnes visant à manipuler le marché de l’information ont créé de faux comptes, comme des trolls et des robots sociaux, et organisé de faux réseaux. Ils ont inondé le réseau pour donner l’impression qu’une théorie du complot ou un candidat politique est populaire, trompant à la fois les algorithmes de la plate-forme et les biais cognitifs des gens. Ils ont même modifié la structure des réseaux sociaux pour créer des illusions sur les opinions majoritaires.

Réduire l’engagement

Que faire? Les plateformes technologiques sont actuellement sur la défensive. Ils deviennent plus agressifs pendant les élections en démantelant les faux comptes et la désinformation préjudiciable. Mais ces efforts peuvent s’apparenter à un jeu de taupe.

Une approche préventive différente consisterait à ajouter de la friction. En d’autres termes, pour ralentir le processus de diffusion de l’information. Les comportements à haute fréquence tels que le goût et le partage automatisés pourraient être inhibés par les tests CAPTCHA, qui nécessitent une réponse humaine, ou des frais. Non seulement cela réduirait les possibilités de manipulation, mais avec moins d’informations, les gens seraient en mesure de prêter plus d’attention à ce qu’ils voient. Cela laisserait moins de place au biais d’engagement pour affecter les décisions des gens.

Il serait également utile que les sociétés de médias sociaux adaptent leurs algorithmes pour s’appuyer moins sur les signaux d’engagement et davantage sur des signaux de qualité pour déterminer le contenu qu’ils vous servent. Peut-être que les révélations des lanceurs d’alerte donneront l’impulsion nécessaire.

Comment « l’engagement » vous rend vulnérable à la manipulation et à la désinformation sur les réseaux sociaux

Fourni par La Conversation

Cet article est republié à partir de The Conversation sous une licence Creative Commons. Lire l’article original.![]()

Citation: Le lanceur d’alerte de Facebook dit que les algorithmes de l’entreprise sont dangereux – voici comment ils peuvent vous manipuler (2021, 7 octobre) récupéré le 8 octobre 2021 sur https://techxplore.com/news/2021-10-facebook-whistleblower-company-algorithms-dangerous .html

Ce document est soumis au droit d’auteur. En dehors de toute utilisation équitable à des fins d’étude ou de recherche privée, aucune partie ne peut être reproduite sans l’autorisation écrite. Le contenu est fourni seulement pour information.

Sommaire