Internet

Les discours de haine en ligne pourraient être contenus comme un virus informatique, selon les chercheurs

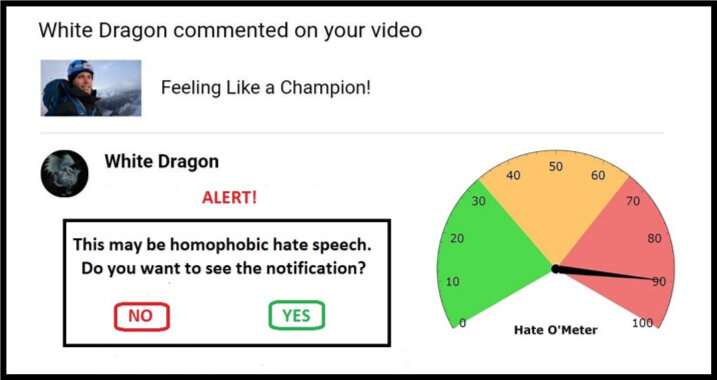

Exemple d'une approche possible pour un écran de quarantaine, complet avec Hate O'Meter. Crédits: Stefanie Ullman

Selon des chercheurs de l'Université de Cambridge, la propagation du discours de haine via les médias sociaux pourrait être combattue en utilisant la même approche de «quarantaine» déployée pour lutter contre les logiciels malveillants.

Les définitions du discours de haine varient en fonction de la nation, de la loi et de la plate-forme, et le simple blocage des mots-clés est inefficace: les descriptions graphiques de la violence n'ont pas besoin de contenir des insultes ethniques évidentes pour constituer des menaces de mort racistes, par exemple.

En tant que tel, le discours de haine est difficile à détecter automatiquement. Elle doit être signalée par ceux qui y sont exposés, après que le "préjudice psychologique" voulu ait été infligé, avec des armées de modérateurs tenus de juger chaque cas.

C'est la nouvelle ligne de front d'un ancien débat: la liberté d'expression contre le langage vénéneux.

Maintenant, un ingénieur et un linguiste ont publié une proposition dans la revue Éthique et technologie de l'information qui exploite les techniques de cybersécurité pour donner le contrôle aux personnes ciblées, sans recourir à la censure.

Les experts de Cambridge Language et Machine Learning utilisent des bases de données de menaces et d'insultes violentes pour créer des algorithmes qui peuvent fournir un score pour la probabilité d'un message en ligne contenant des formes de discours de haine.

À mesure que ces algorithmes s'affinent, les discours de haine potentiels pourraient être identifiés et «mis en quarantaine». Les utilisateurs recevraient une alerte d'avertissement avec un "Hate O'Meter" – le score de gravité du discours de haine – le nom de l'expéditeur, et une option pour afficher le contenu ou supprimer invisible.

Cette approche s'apparente à des filtres de spam et de logiciels malveillants, et les chercheurs du projet « Donner la voix aux démocraties numériques '' pensent qu'elle pourrait réduire considérablement la quantité de discours de haine que les gens sont obligés de subir. Ils visent à avoir un prototype prêt au début de 2020.

"Le discours de haine est une forme de préjudice intentionnel en ligne, comme les logiciels malveillants, et peut donc être traité par le biais de la mise en quarantaine", a déclaré la co-auteure et linguiste Dr. Stefanie Ullman. "En fait, beaucoup de discours de haine sont en fait générés par des logiciels tels que les robots Twitter."

"Des entreprises comme Facebook, Twitter et Google réagissent généralement de manière réactive aux discours de haine", a déclaré le co-auteur et ingénieur Dr. Marcus Tomalin. "Cela peut convenir à ceux qui ne le rencontrent pas souvent. Pour d'autres, c'est trop peu, trop tard."

"De nombreuses femmes et personnes appartenant à des groupes minoritaires aux yeux du public reçoivent un discours de haine anonyme pour avoir osé avoir une présence en ligne. Nous voyons cela dissuader les gens d'entrer ou de continuer dans la vie publique, souvent ceux de groupes qui ont besoin d'une plus grande représentation", at-il dit. m'a dit.

L'ancienne secrétaire d'État américaine Hillary Clinton a récemment déclaré à un public britannique que le discours de haine constituait une "menace pour les démocraties", à la suite de nombreuses femmes parlementaires citant les abus en ligne comme raison pour laquelle elles ne se présenteront plus aux élections.

Dans un discours prononcé à l'Université de Georgetown, le PDG de Facebook, Mark Zuckerberg, a évoqué "de larges désaccords sur ce qui peut être qualifié de haine" et a fait valoir: "nous devons pécher par excès d'expression".

Les chercheurs disent que leur proposition n'est pas une solution miracle, mais qu'elle se situe entre les «approches libertaires et autoritaires extrêmes» consistant à autoriser ou à interdire totalement certaines langues en ligne.

Surtout, l'utilisateur devient l'arbitre. "Beaucoup de gens n'aiment pas l'idée d'une société non élue ou d'un gouvernement de microgestion décidant de ce que nous pouvons et ne pouvons pas nous dire", a déclaré Tomalin.

"Notre système signalera quand vous devez être prudent, mais c'est toujours votre appel. Il n'empêche pas les gens de poster ou de voir ce qu'ils aiment, mais il donne le contrôle nécessaire à ceux qui sont inondés de haine."

Dans l'article, les chercheurs font référence à des algorithmes de détection atteignant une précision de 60% – pas beaucoup mieux que le hasard. Le laboratoire d'apprentissage automatique de Tomalin a maintenant atteint 80%, et il prévoit une amélioration continue de la modélisation mathématique.

Pendant ce temps, Ullman recueille plus de «données d'entraînement»: discours de haine vérifié dont les algorithmes peuvent tirer des leçons. Cela permet d'affiner les «scores de confiance» qui déterminent une mise en quarantaine et la lecture ultérieure de Hate O'Meter, qui peuvent être définis comme un cadran de sensibilité en fonction des préférences de l'utilisateur.

Un exemple de base pourrait impliquer un mot comme «chienne»: une injure misogyne, mais aussi un terme légitime dans des contextes tels que l'élevage de chiens. C'est l'analyse algorithmique de la position syntaxique d'un tel mot – les types de mots environnants et les relations sémantiques entre eux – qui informe le score du discours de haine.

"L'identification de mots clés individuels ne suffit pas, nous examinons des structures de phrases entières et bien au-delà. Les informations sociolinguistiques dans les profils d'utilisateurs et les historiques de publication peuvent toutes aider à améliorer le processus de classification", a déclaré Ullman.

Tomalin a ajouté: "Grâce à des quarantaines automatisées qui fournissent des conseils sur la force du contenu haineux, nous pouvons responsabiliser ceux qui sont à la fin du discours de haine empoisonnant nos discours en ligne."

Cependant, les chercheurs, qui travaillent au Centre de recherche sur les arts, les lettres et les sciences sociales de Cambridge (CRASSH), disent que, comme pour les virus informatiques, il y aura toujours une course aux armements entre le discours de haine et les systèmes pour le limiter.

Le projet a également commencé à s'intéresser au "contre-discours": la façon dont les gens réagissent au discours de haine. Les chercheurs ont l'intention d'alimenter les débats sur la manière dont les assistants virtuels tels que «Siri» devraient répondre aux menaces et à l'intimidation.

L'augmentation du discours de haine en ligne entraîne plus de crimes contre les minorités

Stefanie Ullmann et al, Quarantaine du discours de haine en ligne: perspectives techniques et éthiques, Éthique et technologie de l'information (2019). DOI: 10.1007 / s10676-019-09516-z

Citation:

Selon un chercheur, le discours de haine en ligne pourrait être contenu comme un virus informatique (18 décembre 2019)

récupéré le 18 décembre 2019

depuis https://techxplore.com/news/2019-12-online-speech-virus.html

Ce document est soumis au droit d'auteur. Hormis toute utilisation équitable aux fins d'études ou de recherches privées, aucune

une partie peut être reproduite sans l'autorisation écrite. Le contenu est fourni seulement pour information.

Sommaire